W trakcie przerwy świątecznej użytkownicy platformy X zorientowali się, iż Grok (dostępny na platformie czatbot AI) z łatwością „rozbiera” wskazane osoby. Wystarczyło istniejące zdjęcie, by algorytm wygenerował deepfake, na którym dana osoba (najczęściej kobieta, ale także dziecko) pojawiała się w skąpym bikini lub bieliźnie. Początkowo takie polecenia testowali głównie twórcy treści erotycznych, próbujący zwiększyć zasięgi bardziej prowokacyjnymi wersjami własnych materiałów. Bardzo gwałtownie jednak okazało się, iż większość nowych erotycznych deepfake’ów powstaje bez jakiejkolwiek zgody. Ofiarami były nie tylko celebrytki, ale także osoby prywatne, które po prostu udostępniły w sieci zwykłe zdjęcie.

„GROK, UBIERZ JĄ W BIKINI”

Choć Grok nie jest jedynym narzędziem AI wykorzystywanym w ten sposób, skala zjawiska związanego z botem Muska okazała się bezprecedensowa. Z analizy firmy Copyleaks wynika, iż na przełomie 2025 i 2026 roku Grok generował średnio jeden tego typu obraz na minutę1, publikowany bezpośrednio na platformie X. Użytkownicy oprócz zmiany ubioru prosili o seksualizowane pozy, gesty i kontekst. Polecenia w rodzaju „rozchyl jej nogi” czy „niech się odwróci, żeby pokazać tyłek”, stały się powszechne. Część fraz przestała działać, ale wiele wciąż przynosiło pożądany efekt.

Raport Copyleaks wskazuje, iż mimo prób ograniczania określonych poleceń problem wciąż się utrzymuje. Użytkownicy gwałtownie uczą się omijać zabezpieczenia, modyfikując język promptów. Wśród osób, których wizerunki zostały wykorzystywane, znalazły się m.in. Taylor Swift, Olivia Rodrigo, Millie Bobby Brown czy Sydney Sweeney. Badacze zauważyli także charakterystyczny mechanizm eskalacji: niewinna prośba — np. o zdjęcie w stroju kąpielowym — stawała się punktem wyjścia do coraz bardziej drastycznych manipulacji, napędzanych rywalizacją w komentarzach.

Początkowo użytkownicy prosili Groka o usuwanie ze zdjęcia ubrań i zastępowanie ich „mikro-bikini” lub bielizną. Z czasem w feedzie zaczęły pojawiać się obrazy kobiet związanych, pokrytych lukrem czy ustawianych w coraz bardziej seksualnych pozach.

Grok wykonywał te wszystkie polecenia.

CZY GROK NAPĘDZA CYFROWĄ PRZEMOC SEKSUALNĄ WOBEC KOBIET?

Eksperci ds. cyberbezpieczeństwa alarmują, iż umożliwienie swobodnego modyfikowania wizerunków prawdziwych osób bez ich zgody stwarza poważne ryzyko nękania, wykorzystywania i trwałych szkód.

Zatrzymajmy się na chwilę i nazwijmy to po imieniu.

To nie są pojedyncze incydenty ani przypadkowe nadużycia. Takie deepfake’i to świadome akty cyfrowej przemocy seksualnej, mizognia zaprojektowana systemowo, którą platformy mogłyby zatrzymać, ale obserwują ją w milczeniu.

Nie chodzi tu wyłącznie o wygenerowane cyfrowo zdjęcia. Chodzi o systemową porażkę w regulowaniu technologii AI, które są masowo wykorzystywane do naruszania prywatności, godności i autonomii kobiet.

Gdy ktoś prosi AI o seksualne upokorzenie kobiety — niezależnie od tego, czy jest celebrytką, influencerką czy osobą prywatną — nie jest to ciekawość ani głupi żart. To forma cyfrowej agresji seksualnej.

To celowe użycie technologii do dominacji, uprzedmiotowienia i publicznego upokorzenia. A każdorazowo, gdy platforma pozwala na takie zachowania bez reakcji, normalizuje przemoc. Wysyła kobietom i dziewczętom jasny komunikat: „Twoja godność i zgoda nie są ważne”.

– Z perspektywy psychologicznej im młodsza osoba, tym może być trudniej poradzić sobie z takim doświadczeniem, bo jej tożsamość, granice i relacja z własnym ciałem są jeszcze w trakcie kształtowania, a dynamiczny rozwój sztucznej inteligencji staje się w tym kontekście realnie zagrażający – mówi seksuolożka Miri Palak.

Życie w lęku, iż nasz codzienny wizerunek może zostać erotycznie „użyty”, prowadzi do stałego napięcia i poczucia braku kontroli, ciało przestaje być przeżywane jako „moje”, a zaczyna jako coś, co może zostać użyte przeciwko mnie, jako źródło wstydu, poczucia winy i upokorzenia, co osłabia poczucie bezpieczeństwa w relacjach i przestrzeni publicznej.

Miri Palak, seksuolożka i psycholożka, koordynatorka zespołu Antyprzemocowej Linii Pomocy SEXEDPLEmocjonalne konsekwencje przemocy seksualnej opartej na materiałach wizualnych mogą być bardzo poważne, dlatego warto skorzystać z bezpłatnej i anonimowej pomocy, np. naszych ekspertów.

Antyprzemocowa Linia Pomocy SEXEDPL

Antyprzemocowa Linia Pomocy SEXEDPL TO NIE JEST WOLNOŚĆ SŁOWA

Czas zakończyć tę dyskusję raz na zawsze. To nie ma nic wspólnego z wolnością wypowiedzi. To jest kwestia wolności od wykorzystywania. Seksualizowane treści generowane przez AI bez zgody nie są opinią ani ekspresją. Są naruszeniem — autonomii, bezpieczeństwa i praw człowieka.

Gdzie zgłosić deepfake o charakterze seksualnym? Sprawdź >>

Powoływanie się na wolność słowa służy wyłącznie jednemu celowi: ochronie sprawców i zysków platform, a nie osób krzywdzonych. Kobiety oraz osoby nieletnie zasługują na przestrzeń cyfrową opartą na zgodzie, bezpieczeństwie i równości — nie na systemy, które odwracają wzrok, gdy ich wizerunek jest wykorzystywany w ten sposób.

CO POWINNO SIĘ ZMIENIĆ JAK NAJSZYBCIEJ?

Nie możemy dłużej liczyć na to, iż platformy „same się uregulują”. To się nie wydarzy. Potrzebne są konkretne działania:

- Prawo musi nadążyć. Konieczne jest uchwalenie i egzekwowanie przepisów penalizujących nadużycia AI. Koniec z szarą strefą.

- AI musi być przeprojektowana. Systemy powinny automatycznie oznaczać, moderować i eskalować przypadki nadużyć. AI nie może tylko grzecznie odmawiać — musi uruchamiać alarm.

- Platformy muszą wziąć odpowiedzialność. Koniec z chowaniem się za regulaminami. jeżeli zarabiasz na narzędziach AI, odpowiadasz za sposób, w jaki są wykorzystywane — i nadużywane.

Nie możemy budować przyszłości sztucznej inteligencji na zautomatyzowanej krzywdzie i opcjonalnej sprawiedliwości. Musimy budować ją na odpowiedzialności, godności i zgodzie. Bo jeżeli AI potrafi „rozebrać” osobę i jednocześnie zignorować wykryte nadużycie, to nie jesteśmy już w świecie innowacji. Jesteśmy w nowej epoce przemocy: cyfrowej, publicznej i systemowo ignorowanej.

CZY MUSK COŚ Z TYM ROBI?

Mimo narastających dowodów na nadużycia Elon Musk przez cały czas przedstawia Groka jako narzędzie przyszłości, zdolne do odkrywania nowych technologii, a choćby „nowej fizyki”. Jak dotąd jednak najbardziej widocznym efektem jego działania pozostaje coś znacznie mniej wzniosłego: masowa produkcja deepfake’ów, które zamieniają cudzy wizerunek w przedmiot upokorzenia i rozrywki.

Udostępniasz zdjęcia swojego dziecka w sieci? Sprawdź, czym grozi sharenting?

Skala nadużyć wywołała reakcje w wielu krajach2. Władze we Francji i Indiach prowadzą postępowania wyjaśniające, a brytyjski regulator Ofcom zapowiedział analizę działań X i xAI pod kątem ochrony użytkowników, w tym nieletnich. Podobne dochodzenie wszczęła Komisja Europejska, koncentrując się szczególnie na seksualizowanych obrazach dzieci. „Materiały przedstawiające seksualne wykorzystywanie dzieci są nielegalne i nie mają miejsca w Europie” — podkreślili przedstawiciele UE.

Źródła:

- Grok and the Rise of Nonconsensual Image Manipulation, https://copyleaks.com/blog/grok-and-nonconsensual-image-manipulation ︎

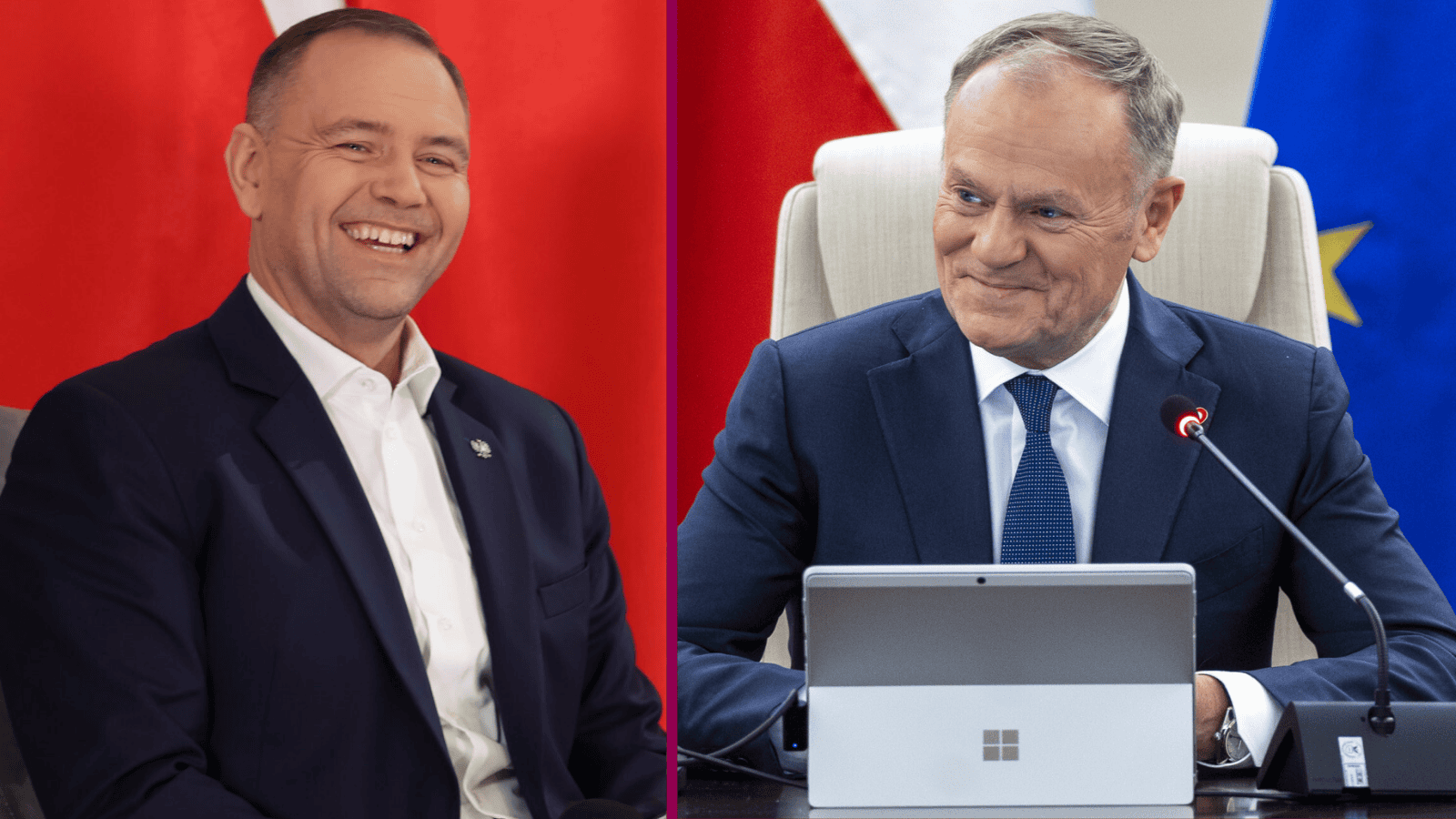

- grok elona Muska wymknął się spod kontroli. Rozbiera kobiety, https://wiadomosci.onet.pl/kraj/grok-muska-wymknal-sie-spod-kontroli-rozbiera-kobiety-nawrockiemu-pomalowal-twarz/wh1f5zw ︎