Meta Ray-Ban to świetny gadżet, ale nikt nie chce rozmawiać ze sztuczną inteligencją na głos w zatłoczonym autobusie czy w biurze.

Z najnowszych przecieków Bloomberga wynika, iż Apple mocno przyspiesza prace nad własnymi inteligentnymi okularami. I tu wszystkie kropki zaczynają się łączyć – kluczem do ominięcia największej wady inteligentnych okularów może być technologia, o której zaledwie trzy tygodnie temu mówił Wojtek Pietrusiewicz w naszym Raporcie Wideo.

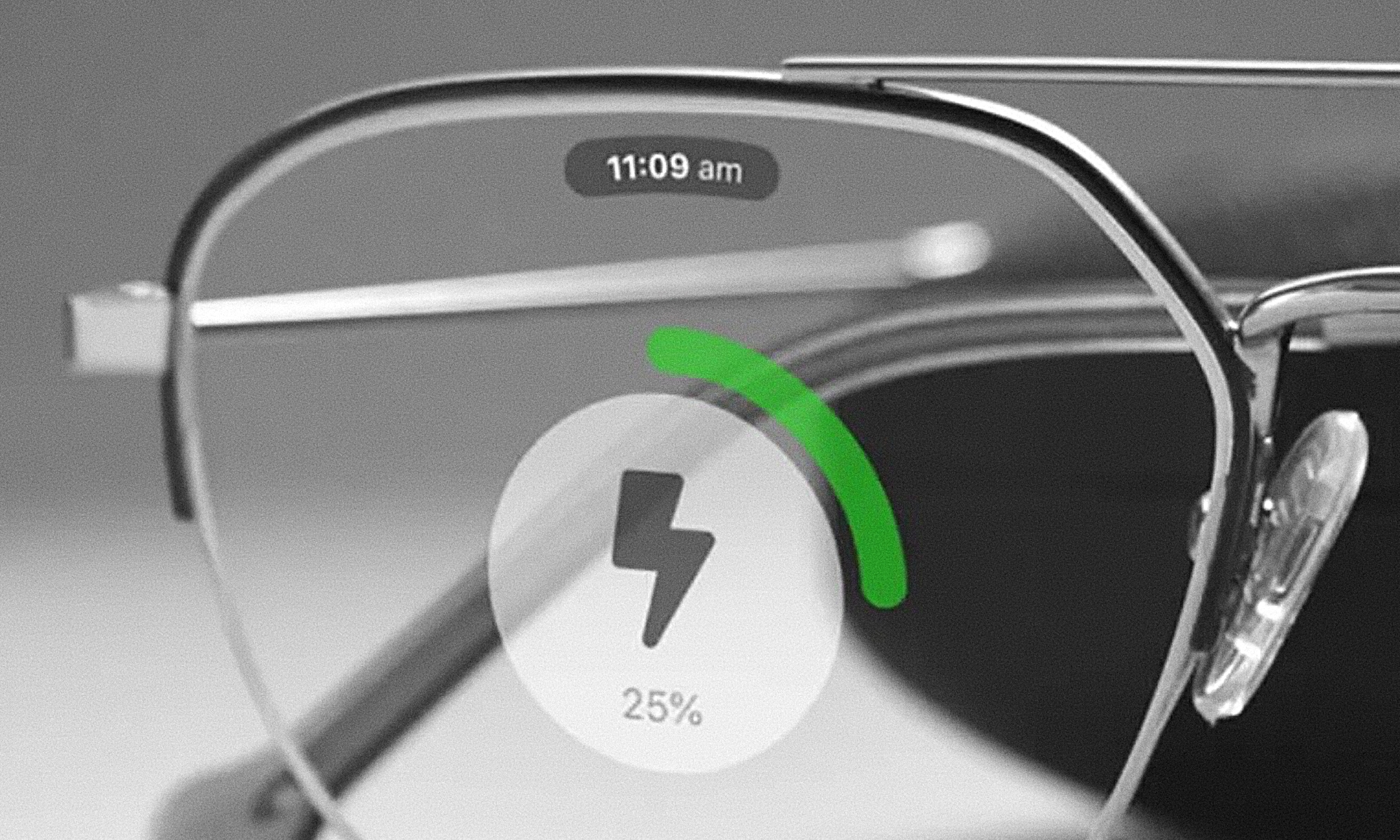

Jeżeli śledzicie plotki ze świata Apple, z pewnością wiecie, iż firma od dawna marzy o opanowaniu naszych twarzy. Choć Vision Pro to technologiczny cud, jest on sprzętem niszowym. Jak informuje Mark Gurman z Bloomberga, w laboratoriach w Cupertino właśnie zapadła decyzja o znacznym przyspieszeniu prac nad trzema nowymi urządzeniami ubieralnymi (wearables): inteligentnym wisiorkiem, słuchawkami AirPods wyposażonymi w kamery oraz – co najważniejsze – inteligentnymi okularami AI, będącymi bezpośrednią odpowiedzią na hitowe okulary Mety i Ray-Bana. Tylko jak Apple zamierza pokonać największy problem tego typu urządzeń?

Pierwsze wrażenia z Meta Ray-Ban Wayfarer – rób zdjęcia, wideo lub livestreamuj

Bariera wstydu, czyli dlaczego nie gadamy do okularów

Okulary Meta Ray-Ban to sprzedażowy hit końca 2023 i początku 2024 roku. Mają świetne kamery, dobre głośniki i zintegrowanego asystenta Meta AI, który może analizować to, na co właśnie patrzymy. Problem polega na tym, iż na co dzień ta ostatnia funkcja jest niemal bezużyteczna.

Powód jest prozaiczny: bariera społeczna. Zdecydowana większość z nas czuje się bardzo niekomfortowo, wydając na głos komendy maszynie w przestrzeni publicznej. Pytanie asystenta na ulicy, w kawiarni czy w komunikacji miejskiej przyciąga niechciane spojrzenia i po prostu bywa krępujące. choćby szept jest często zbyt głośny (lub niewyraźny dla mikrofonów w hałaśliwym otoczeniu).

Rozwiązaniem tego problemu nie jest lepszy mikrofon. Rozwiązaniem jest interfejs, który pozwala „rozmawiać” w całkowitej ciszy.

Połączmy kropki: raport wideo i akwizycja Q.ai

Na początku lutego na naszym kanale YouTube opublikowaliśmy Raport Wideo, w którym Wojtek Pietrusiewicz wziął na tapet bardzo ciche, ale potężne przejęcie, jakiego dokonało Apple. Gigant zapłacił 2 miliardy dolarów za startup o nazwie Q.ai.

Jak tłumaczył Wojtek w materiale, firma ta nie zajmuje się po prostu polepszaniem rozpoznawania mowy. Q.ai to specjaliści od silent voice input (bezgłośnego wprowadzania głosu) oraz systemów uczenia maszynowego potrafiących odczytywać mikroruchy mięśni twarzy. Krótko mówiąc: to technologia, która rozumie to, co mówisz, choćby jeżeli z Twoich ust nie wydobywa się żaden dźwięk. Wystarczy sama praca aparatu mowy.

Siri, która czyta z twarzy

Teraz, w świetle najnowszych raportów o przyspieszeniu prac nad okularami, przejęcie Q.ai nabiera zupełnie nowego, potężnego sensu. Apple nie potwierdziło jeszcze, do jakiego konkretnego produktu trafi ta technologia, ale analitycy rynku niemal jednogłośnie wskazują na przyszłe urządzenia ubieralne.

Wiele wskazuje na to, iż to nie był zakup wyłącznie z myślą o ulepszaniu Siri w iPhonie. Może to być fundament pod przyszłe Apple Glasses. Wyobraźcie to sobie: macie na nosie okulary od Apple. Sensory umieszczone w zausznikach (bezpośrednio przylegających do kości i mięśni twarzy) rejestrują minimalne, neuromięśniowe impulsy lub mikroruchy szczęki. Chcecie zapytać asystenta, do jakiego budynku właśnie podchodzicie, albo podyktować krótką odpowiedź na wiadomość z iMessage. Po prostu „wypowiadacie” te słowa pod nosem – zupełnie bezgłośnie. Asystent rozumie komendę i szepcze Wam odpowiedź bezpośrednio do ucha przez kierunkowe głośniki.

Pełna dyskrecja, zero niezręczności i gigantyczny skok komfortu w przestrzeni publicznej.

Apple po raz kolejny nie będzie pierwsze. Meta już pokazała, iż inteligentne okulary z aparatem mają sens. Ale to firma Tima Cooka – kupując startup taki jak Q.ai za gigantyczne pieniądze – może jako pierwsza wyeliminować największy zgrzyt user experience (doświadczenia użytkownika), który powstrzymywał tę kategorię sprzętu przed staniem się prawdziwie masową.

Jeśli jeszcze nie widzieliście materiału Wojtka, gorąco polecamy nadrobić zaległości – to świetny przykład tego, jak pozornie suche informacje finansowe z początku miesiąca pomagają wyobrazić sobie gadżety, które za chwilę będziemy nosić na nosie.

Jeśli artykuł Już domyślamy się, po co Apple wydało 2 mld dolarów. Okulary z Siri mogą „przeczytać” nasze słowa z mikroruchów twarzy nie wygląda prawidłowo w Twoim czytniku RSS, to zobacz go na iMagazine.